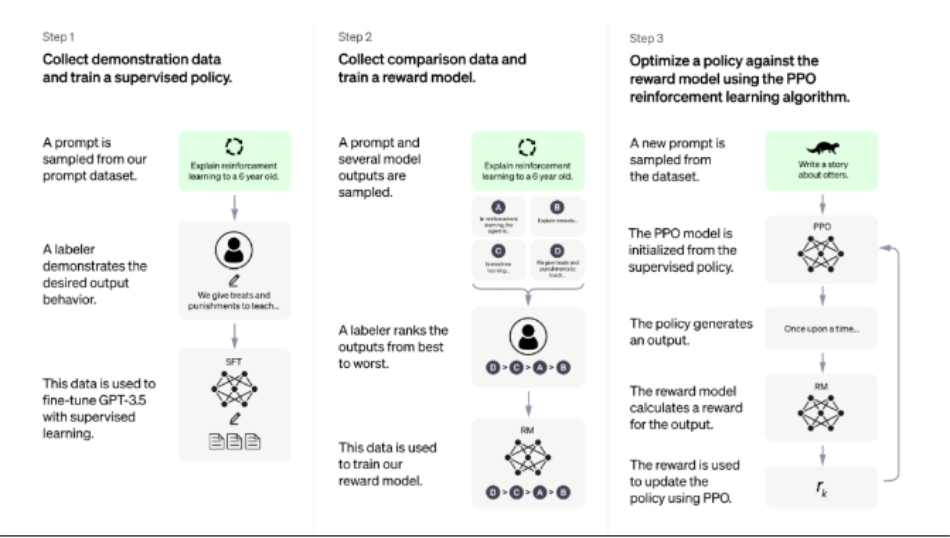

ChatGPT est un chatbot IA avancé, entraîné par OpenAI, qui interagit de manière conversationnelle. Ce format de dialogue permet à ChatGPT de répondre aux questions complémentaires, de reconnaître ses erreurs, de remettre en question les hypothèses erronées et de rejeter les demandes inappropriées.

La technologie GPT permet d'écrire du code rapidement et avec précision en utilisant le langage naturel comme guide. GPT peut prendre une invite textuelle et générer du code adapté à la tâche donnée. Cette technologie permet de réduire le temps de développement, car elle génère du code rapidement et avec précision. Elle contribue également à réduire le risque d'erreurs, car GPT est capable de générer du code immédiatement testable et utilisable.

Google a transmis des questions d'entretien de codage à ChatGPT et, sur la base des réponses de l'IA, a déterminé qu'il serait embauché pour un poste d'ingénieur de niveau trois, selon un document interne.

Des chercheurs auraient récemment soumis ChatGPT à l'examen d'autorisation d'exercer la médecine aux États-Unis. Selon un rapport de décembre, ChatGPT « a obtenu des résultats proches du seuil de réussite aux trois examens, sans aucune formation ni renforcement ».

ChatGPT, est-ce vraiment si fiable ?

L'une des limites des grands modèles linguistiques est que nous ne sommes pas capables de comprendre le contexte ou le sens des mots que nous générons. Nous ne pouvons produire du texte qu'en fonction des probabilités d'apparition simultanée de certains mots ou séquences de mots, selon les données d'entraînement dont nous disposons. Cela signifie que nous ne pouvons pas fournir d'explications ni de raisonnements pour nos réponses, et que nous ne générons pas toujours des réponses parfaitement cohérentes ou pertinentes dans le contexte d'une conversation.

Une autre limite réside dans le fait que nous n'avons pas accès à l'immense quantité de connaissances dont dispose un être humain. Nous ne pouvons fournir que les informations sur lesquelles nous avons été formés, et nous ne pouvons peut-être pas répondre à des questions qui ne relèvent pas de nos données d'entraînement.

Enfin, comme nous sommes entraînés sur une grande quantité de données, nous pouvons parfois générer des réponses contenant un langage offensant ou inapproprié. Ce n'est pas intentionnel, mais il s'agit d'une limitation des données d'entraînement qui nous ont été fournies et des algorithmes que nous utilisons pour générer le texte.

Les nouvelles ci-dessus proviennent de :China Daily

Dans le domaine de la conception de puzzles, nos concepteurs se sentent également menacés par Chat GPT, mais notre travail de conception consiste davantage à ajouter de la création et de la compréhension humaines, ce qui ne pourrait pas remplacer le concepteur humain, comme le sens des couleurs et l'intégration culturelle que l'homme souhaite exprimer dans le puzzle.

Date de publication : 8 mai 2023